AI大模型变革内容生成,财经信息领域如何应对挑战?

AI导读:

随着AI大模型火爆全网,财经信息领域面临信息过载、模型偏见、逻辑自证陷阱等风险。中央网信办提出整治AI技术滥用乱象。文章探讨了政府、企业、公众等主体如何直面AI大模型“幻觉”问题,并给出了最优解和有效监管建议。

随着人工智能(AI)大模型火爆全网,内容生成形态已然发生了颠覆性的变革,一些挑战与风险也随之而来,尤其是在财经信息领域。

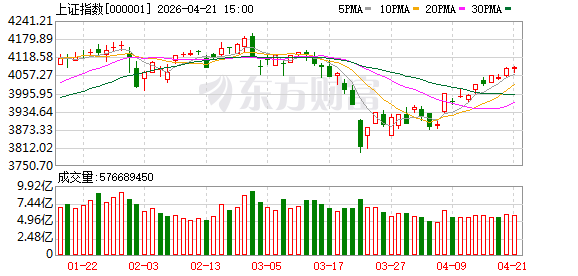

一份由头豹研究院2月26日发布的《从Deepseek现象到信息治理革命:共建数字时代清朗空间》(下称《报告》)微报告称,“AI技术进步在提升生产效率的同时,也带来了信息过载严重、模型偏见加剧、逻辑自证陷阱等风险”。通俗来讲,一旦媒体、券商、咨询机构等使用AI大模型生成了虚假或错误内容,不但会严重削弱公众对结果真实性的信任,还会引发资本市场波动,如股市热点中的不实信息传播,并且低成本的内容生成模式已对数据中心、芯片厂商等传统产业链产生冲击。

事实上,中央网信办也在近期发布了2025年“清朗”系列专项行动整治重点并明确提出,要“整治‘自媒体’发布不实信息、整治AI技术滥用乱象”。那么,政府、企业、公众等各方主体正在面对的AI大模型“幻觉”问题应如何解决?

直面“幻觉”

《报告》中提到的“信息过载严重”,在于AI大模型会将各种来源和立场的内容混杂在一起,而公众难以在海量信息中迅速辨别信息的权威与否和真伪。

此外,AI大模型会出现“模型偏见加剧”,即由于训练过程中的潜在偏见和错误被放大所导致生成内容出现事实偏差和歪曲。而“逻辑自证陷阱”则指AI大模型能通过看似严谨的论证构建出看似合理的内容结果。

《报告》撰写方、头豹联合创始人兼总裁王晨晖告诉记者,AI大模型一旦生成了虚假或错误内容,会对“内容生态”以及公众产生一系列严重影响,尤其是在股市热点、期货要闻等领域。现有的内容生态包括传统的媒体和新闻机构、券商、研究咨询机构、投行等。

为应对这些问题,王晨晖建议,首先在内容生产阶段,内容创作必须依赖专业团队或具备高度专业性的机构进行严格把关,确保内容的专业性、准确性和可靠性。特别是在资本市场、公共健康等领域,内容的准确性至关重要。

其次,内容发布平台需建立完善的溯源审查机制,确保每一条信息都能追溯到其源头,尤其对于AI生成内容(AIGC),要建立系统化的真实性和时效性审查标准。

在中国数实融合50人论坛副秘书长胡麒牧看来,AI大模型之所以会生成虚假或错误内容与模型训练相关,但本质还是语料输入的问题。

胡麒牧解释,一方面,现有的一些通用大模型在进行训练时,其输入的语料并非专业数据而是公共数据。另一方面,一些通用大模型目前通过公域渠道拿到的数据里,英文语料比较多,中文语料非常少。

找到最优解

避免AI大模型产生“幻觉”,业内有最优解吗?

上海人工智能研究院算法专家陆文韬告诉记者,为了能有效避免AI大模型生成错误结果、产生“幻觉”,从技术实现角度应该注意三个方面问题。

第一,确保训练数据的高质量和多样性至关重要。训练数据应做到标注来源、时效性和引用链,使用准确、权威的数据源。

第二,是调整模型架构与训练策略。可以采用“预训练+强化学习+人类反馈”的混合范式。

第三,完善实时监控与反馈机制。在AI大模型部署后,需要建立实时监控系统,检测并纠正潜在的错误输出。

胡麒牧表示,行业、企业掌握着优质语料,但这一方面在于企业要主动训练自己专有的AI大模型。另一方面,要让企业拿出专业语料库,一些数据流通和交易机制必不可少。

陆文韬告诉记者,未来,如何平衡语料价值挖掘与技术秘密保护之间的关系是重点。

陆文韬表示,数据脱敏与加密、可信数据生态构建等方法都值得行业、企业在实操过程中借鉴。

有效监管

上述《报告》称,随着信息生态复杂度不断提升,单一的管理和监管手段已难以应对虚假信息的广泛传播。网络安全公司可以与AI技术联手,构建起从语料生成到最终内容输出的全链条监控体系。

胡麒牧表示,AI大模型会在接收专业语料输入的同时,通过不断地纠偏、调整来达到一个安全“域值”。目前,监管部门全流程监控AI大模型还不太现实,但可以通过了解安全“域值”来提前预判风险。

陆文韬则从技术层面给出建议称,制度与技术需要协同。比如,创建白名单知识库;在金融等领域强制调用权威知识库,确保信息的准确性和可靠性。

王晨晖也呼吁,需要跨行业的协作,共同构建起一个坚固的内容监管链条,才能推动AI时代内容的普惠化生产。

(文章来源:第一财经)

郑重声明:以上内容与本站立场无关。本站发布此内容的目的在于传播更多信息,本站对其观点、判断保持中立,不保证该内容(包括但不限于文字、数据及图表)全部或者部分内容的准确性、真实性、完整性、有效性、及时性、原创性等。相关内容不对各位读者构成任何投资建议,据此操作,风险自担。股市有风险,投资需谨慎。如对该内容存在异议,或发现违法及不良信息,请发送邮件至yxiu_cn@foxmail.com,我们将安排核实处理。